موتورهای جستجو چگونه کار می کنند؟

موتورهای جستجو به مانند ماشین های پاسخگویی هستند. آنها با این هدف به وجود آمده اند که محتوای منتشر شده در اینترنت را کشف، درک و سپس طبقه بندی کنند تا در هنگام پرسش کاربران از طریق جستجو، مرتبط ترین آیتم ها را به آنها نشان دهند.

برای نمایش بهتر سایت در نتایج جستجو نیاز است که محتوای وب سایت در قدم اول برای موتورهای جستجو قابل دسترسی باشد. این موضوع مسلما مهمترین قطعه پازل سئو است، چرا که یک سایت بدون پیدا شدن، راهی برای نمایش در نتایج جستجو نخواهد داشت.

موتورهای جستجو چگونه کار می کنند؟

موتورهای جستجو دارای سه عملکرد اصلی هستند:

- پایش (Crawl): جستجوی محتوا در وب و گشتن محتوا و کدها در هر یو آر ال کشف شده.

- ایندکس (index): ذخیره سازی و طبقه بندی محتوای پیدا شده در مرحله پایش. با قرار گرفتن یک صفحه در ایندکس، آن صفحه شانس نمایش در نتایج جستجو را خواهد داشت.

- رتبه بندی (Rank): فراهم کردن لیستی از محتواهای مرتبط و مناسب با جستجوی یک عبارت. نتایج جستجو بر اساس معیار بیشترین ارتباط مرتب می شوند.

پایش موتورهای جستجو چیست؟

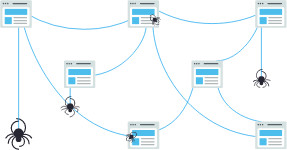

پایش (Crawling) به فرایندی گفته می شود که در آن تیمی از ربات ها (تحت عنوان پایشگر یا اسپایدر) به اینترنت متصل شده و محتواهای جدید و بروزرسانی شده را کشف می کنند. محتواها می توانند انواع مختلفی مانند صفحه وب، تصویر، ویدئو یا PDF داشته باشند. اما جدا از هر فرمتی محتواها با استفاده از لینک ها شناسایی می شوند.

ربات گوگل با نام گوگل بات (Googlebot) شروع به مشاهده چند صفحه از وب کرده و سپس لینک های موجود در آن را با هدف کشف صفحات جدید دنبال می کند. با ادامه این کار پایشگر قادر است که محتواهای جدید را یافته و آن را به ایندکس خود تحت نام کافئین (Caffeine) – دیتابیس عظیمی از یو آر ال های کشف شده – اضافه کند. در نتیجه اطلاعات مورد نظر کاربر در زمان درخواست آن، از این طریق فراخوانی می شود.

ایندکس موتورهای جستجو چیست؟

موتورهای جستجو به پردازش و ذخیره سازی اطلاعات کشف شده در قالب یک اینکدس می کنند. ایندکس شامل دیتابیس عظیمی از محتوای یافت شده است که در زمان جستجو کاربر، توسط موتورهای جستجو استفاده میشود.

رتبه بندی سایت ها در موتورهای جستجو

درست پس از زمان جستجوی کاربران، موتورهای جستجو شروع به گشتن در بین مطالب مرتبط کرده و آنها را بر اساس عبارت مورد جستجوی کاربر به شکل لیستی مرتب می کنند. به عملیات تهیه این لیست، رتبه بندی گفته می شود. در حالت کلی شما اینطور می توانید تصور کنید که هر چه رتبه یک وب سایت بالاتر باشد، میزان ارتباط محتوای آن با عبارت جستجو شده بیشتر است.

این امکان وجود دارد که از پایش تمام سایت یا برخی از صفحات آن ممانعت به عمل آورد یا اینکه جلوی ایندکس شدن برخی از صفحات در موتورهای جستجو را گرفت. با اینکه ممکن است دلایلی برای انجام این کار وجود داشته باشد، اما شما بایستی در ابتدا اطمینان حاصل کنید که صفحات مورد نظرتان از طرف موتورهای جستجو قابل پایش و ایندکس باشد. در غیر این صورت آن صفحه در نتایج جستجو پدیدار نمی شود.

در انتهای این قسمت شما متوجه خواهید شد که بایستی همگام با موتورهای جستجو کار کرد، نه اینکه بر علیه آنها بود.

همه موتورهای جستجو در سئو یکسان نیستند

بسیاری از مبتدیان از اهمیت نسبی برخی از موتورهای جستجوی خاص تعجب می کنند. بسیاری از افراد می دانند که گوگل بزرگترین سهم بازار جستجو را از آن خود دارد، اما بهینه سازی برای بینگ، یاهو و بقیه چقدر مهم است؟ حقیقت اینست که با وجود حداقل بیست موتور جستجوی بزرگ در دنیا، توجه جامعه سئو بر روی گوگل متمرکز است. اما چرا؟ پاسخ کوتاه به این سوال ایسنت که بیشتر جستجوهای دنیا در گوگل انجام می شود. اگر ما علاوه بر بخش وب گوگل، بخش های تصاویر، نقشه و یوتیوب (تحت مالکیت گوگل) را نیز در نظر بگیریم، بیش از 90% جستجوهای دنیا در گوگل رخ می دهد. این عدد 20 برابر بیشتر از جمع سهم بینگ و یاهو است.

پایش: آیا موتورهای جستجو می توانند صفحات سایت را پیدا کنند؟

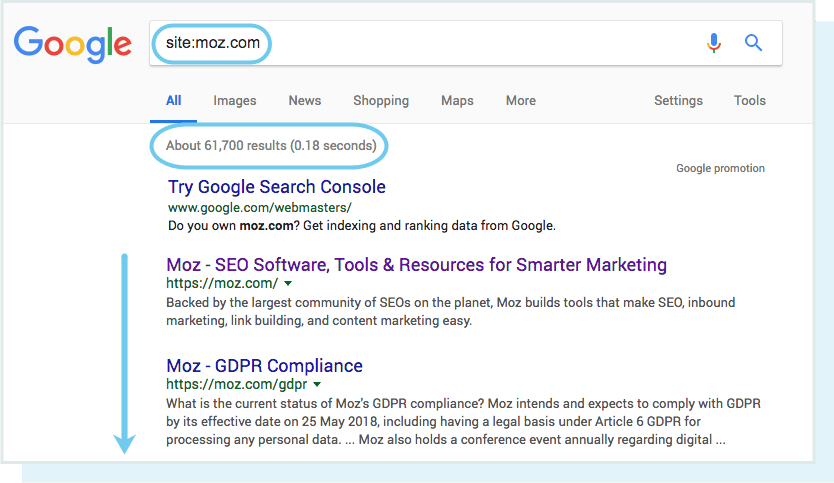

همانطور که تاکنون آموخته اید، پایش و ایندکس شدن صفحات سایت، پیش نیاز دیده شدن در نتایج جستجو است. اگر هم اکنون صاحب وب سایتی هستید، بهتر است که تعداد صفحات ایندکس شده آن را بررسی کنید. این کار موجب می شود که دید اولیه خوبی نسبت به پایش صفحات سایت داشته باشید.

یکی از روش های چک کردن ایندکس سایت، استفاده از اپراتور site: به شکل site:domain.com است. در گوگل عبارت site:domain.com را جستجو کنید و به جای domain.com نام دامنه خود را قرار دهید. با این کار به تعداد صفحات ایندکس شده سایت در گوگل پی خواهید برد.

تعداد صفحاتی که گوگل در چنین شرایطی نشان می دهد، خیلی عدد دقیقی نیست، اما می توان ایده اولیه ای از صفحات ایندکس شده و نوع نمایش آنها در نتایج جستجو کسب کرد.

برای کسب نتیجه دقیق در این مورد بایستی بخش Coverage در گوگل سرچ کنسول را بررسی کنید. داشتن اکانت در گوگل سرچ کنسول رایگان بوده و با مراجعه به آدرس این ابزار می توانید در آن ثبت نام نمایید. با استفاده از این ابزار می توانید نقشه سایت خود را (لیستی از آدرس های صفحات وب سایت) در آن ثبت کرده و تعداد صفحات قرار گرفته در ایندکس گوگل از این لیست را مشاهده نمایید. البته کارکردهای این ابزار به همین مورد ختم نمی شود.

در صورتی که وب سایت شما در نتایج گوگل نمایش داده نمی شود، دلایل محتملی وجود دارد:

- سایت شما به تازگی راه اندازی شده و هنوز پایش نشده است.

- به سایت شما در هیچ وب سایت ایندکس شده دیگری لینک داده نشده است.

- ساختار سایت شما به گونه ایست که ربات ها قادر به پایش صحیح آن نیستند.

- وب سایت شما دارای کدهای دستوریست که مانع از پایش ربات های موتورهای جستجو می گردد.

- سایت شما به دلیل نقض قوانین گوگل جریمه شده است.

به موتورهای جستجو اعلام کنید که چگونه وب سایت شما را پایش کنند

اگر با استفاده از اپراتور site: صفحات مهم سایت خود را مشاهده نمی کنید، یا اینکه صفحاتی می بینید که اصولا نبایست در نتایج جستجو قرار گیرند، بدانید که بهینه سازی هایی در این شریط وجود دارد که می توان با اجرای انها به موتورهای جستجو اعلام کرد که چگونه به پایش صفحات سایت بپردازند. اعلام صفحات سایت مجاز برای بازدید شدن از طرف موتورهای جستجو می تواند به شما امکان دهد تا ایندکس موتورهای جستجو از وب سایت خود را کنترل نمایید.

بسیاری از افراد تنها به ایندکس شدن صفحات مهم سایت در گوگل بسنده می کنند، اما صفحات زیادی نیز در این بین وجود دارند که شما علاقه مند به ایندکس شدن آنها نیستید و اغلب هم فراموششان می کنید. این صفحات شامل یو آر ال های بدون محتوا، محتوای تکراری (مانند آدرس های دارای پارامتر های مرتبط با فیلتر و مرتب کردن آیتم ها در فروشگاه های اینترنتی)، صفحات تست و از این قبیل می شوند.

برای دور کردن گوگل از پایش صفحاتی خاص می توان از robots.txt استفاده کنید.

Robots.txt

فایل robots.txt در مسیر روت سایت قرار گرفته (مانند domain.com/robots.txt) و به گوگل دستور می دهد که کدام قسمت را پایش کرده و کدام قسمت را پایش نکند.

چگونه گوگل بات با فایل robots.txt رفتار می کند؟

- اگر گوگل بات فایل robots.txt را در سایتی مشاهده کند، قبل از پایش سایت آن را پردازش می کند.

- اگر گوگل بات فایل robots.txt را در سایتی مشاهده کند، غالبا از دستورات آن پیروی می کند.

- در صورتی که گوگل بات خطایی را در در هنگام دسترسی به فایل robots.txt مشاهده کند، بخش های مبهم سایت را پایش نخواهد کرد.

از سهمیه پایش خود درست استفاده کنید

هر وب سایتی از دید گوگل بات دارای سهمیه پایش محدودی است. بدین معنا که گوگل بات پس از ورود به سایت تقریبا تعداد صفحات مشخصی را بازبینی می کند. بنابراین استفاده درست از این سهمیه به ما اطمینان می هد که گوگل زمان خود را در سایت ما هدر نداده و صفحات مهم سایت را نادیده نمی گیرد. سهیمه پایشی در وب سایت های بسیار بزرگ و دارای صفحات زیاد، اهمیت بیشتری پیدا می کند. در چنین وب سایت هایی بد نیست که صفحات بی اهمیت سایت را از دسترس گوگل بلاک کنیم. فقط دقت داشته باشید که این دستورات با دیگر دستورات قرار گرفته در صفحات سایت مانند کانونیکال یا تگ های نوایندکس تداخلی نداشته باشد. در صورتی که گوگل بات از دسترسی به آن صفحات بلاک شده باشد، این گونه دستورات را مشاهده نخواهد کرد.

دقت داشته باشید که تمام ربات ها از دستورات robots.txt پیروی نمی کنند. برخی از ربات های یابنده ایمیل یا دیگر ربات های جاسوسی به جستجوی اطلاعات خصوصی شما در این گونه صفحات بلاک شده می پردازند. اگرچه ممانعت از دسترسی به صفحاتی مانند صفحات ورود یا صفحات مدیریت سایت از طریق robots.txt منطقی به نظر میرسد، اما در حقیقت شما با این کار این صفحات را به این گونه ربات های بد معرفی می کنید. بهتر است در چنین سناریوهایی به نو ایندکس کردن صفحات پرداخته و صفحات مدیریتی را تنها در صورت ورود اکانت قابل دسترس نمایید.

در صورت نیاز به اطلاعات بیشتر پیشنهاد می کنیم که مطلب فایل robots.txt چیست را مطالعه نمایید.

تعریف پارامترهای URL در گوگل سرچ کنسول

برخی از وب سایت ها مانند فروشگاه های اینترنتی محتوای تقریبا یکسانی را از طریق یو آر ال ها متفاوت و دارای پارامتر نمایش می دهند. در صورتی که از طرفداران خرید آنلاین هستید، مطمئنا محصولات صفحات را با استفاده از فیلترها محدود تر کرده اید. به عنوان مثال فرض می کنیم که شما در یک فروشگاه اینترنتی به صفحه لباس رفته و نتایج را بر اساس سایز، رنگ یا استایل فیلتر کرده اید. با هر بار تغییر این فیلترها یو آر ال ها دچار کمی تغییر می شوند:

https://www.example.com/products/women/dresses/green.htm

https://www.example.com/products/women?category=dresses&color=green

https://example.com/shopindex.php?product_id=32&highlight=green+dress&cat_id=1&sessionid=123$affid=43

گوگل چگونه می تواند آدرس صحیح برای نمایش در نتایج جستجو را تشخیص دهد؟ گوگل دارای الگوریتم خوبی برای شناسایی صفحات درست در این شرایط است، اما در عین حال ابزاری در گوگل سرچ کنسول نیز تهیه کرده تا شما قادر به مدیریت این قسمت باشید. در صورتی که به گوگل اعلام کنید که صفحات دارای یک پارامتر به خصوص را پایش نکند، گوگل بات دیگر به آن صفحات سر نزده و احتمالا از نتایج جستجو نیز پاک خواهند شد. این همان چیزیست که شما می خواهید، چرا که این صفحات موجب ایجاد محتوای تکراری شده و وجود آنها در ایندکس گوگل به صلاح سایت نیست.

آیا پایشگرها قادر به یافتن تمام صفحات مهم سایت هستند؟

حال که با تاکتیک هایی برای اطمینان از دور ماندن موتورهای جستجو از صفحات بی اهمیت آشنا شده اید، می خواهیم در مورد روش های بهینه سازی ای صحبت کنیم که به موتورهای جستجو در یافتن صفحات مهم سایت کمک می کند.

در برخی مواقع موتورهای جستجو قادر به یافتن بخش هایی از سایت به دلیل مبهمی نیستند. دیده شدن تمام قسمت های سایت از دید ربات های موتورهای جستجو امری ضروریست. تنها مشاهده صفحه اصلی سایت کافی نیست.

آیا محتوای شما پشت فرم ورود مخفی شده است؟

اگر مشاده محتوای سایت نیاز به ورود به اکانت، پر کردن یک فرم یا پاسخ به یک نظرسنجی دارد، مورتورهای جستجو قادر به مشاهده آن صفحات نخواهند بود، چرا که پایشگرها اقدام به ساخت اکانت و ورود به آن جهت مشاهده محتوا نمی کنند.

آیا شما به فرم جستجوی سایت بسنده کرده اید؟

ربات ها قادر به استفاده از فرم های جستجو نیستند. برخی از افراد بر این باورند که وجود فرم جستجو در سایت موجب می شود که موتورهای جستجو بتوانند از تمام صفحات سایت بازدید نمایند.

آیا محتوای متنی در قالب یک محتوای غیر متنی مخفی شده است؟

از تصاویر و ویدئو ها نبایست برای نمایش متن با هدف ایندکس شدن استفاده نمود. با اینکه موتورهای جستجو نسبت به گذشته توانایی درک بالاتری از تصاویر دارند، اما نمی توان خیلی به آن اتکا کرد. قرار دادن متن در قالب HTML بهترین راهکار است.

آیا موتورهای جستجو از ساختار سایت شما پیروی می کنند؟

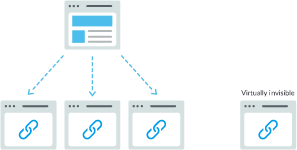

همانطور که وب سایت شما برای پیدا شدن نیاز به لینکی در خارج از سایت دارد، موتورهای جستجو نیز برای یافتن تمام محتوای سایت نیاز به مشاهده لینک آنها در داخل سایت دارند. اگر یکی از صفحات سایت شما در هیچ یک از دیگر صفحات لینکی نداشته باشد، آن صفحه از دید ربات ها مخفی خواهد ماند. متاسفانه بسیاری از سایت ها ساختار خود را به گونه ای ایجاد می کنند که بسیاری از صفحات سایتشان از دید ربات ها در دسترس نیست و در نتیجه در نتایج جستجو قرار نمی گیرد.

اشتباهات رایج در ساختار سایت:

- استفاده از ساختار موبایل متفاوت با دسکتاپ

- هر گونه ساختاری که در آن منوی اصلی سایت در قالب HTML نیست، مانند منوهای مبتنی بر جاوا اسکریپت. گوگل در درک و پایش جاوا اسکریپت بهتر شده است، اما هنوز کامل نیست. مطمئن ترین روش برای ایجاد یک ساختار قابل درک توسط گوگل، ارائه آن به شکل HTML است.

- شخصی سازی یا نمایش ساختارهای متفاوت به کاربران مختلف

- فراموش کردن لینک دادن به صفحات مهم وب سایت از طریق ساختار اصلی سایت. دقت داشته باشید که لینک ها مسیر رسیدن به صفحات جدید هستند.

به همین دلایل است که وجود ساختاری واضح برای سایت ضروری است.

آیا ساختار وب سایت شما واضح است؟

معماری اطلاعات، علم طبقه بندی و لیبل گذاری محتوای وب سایت به شکلیست که موجب ارتقا کارایی وب سایت برای کاربران شود. بهترین نوع معماری اطلاعات نوع بصری آن است، بدین معنی که کاربران نیاز به فکر کردن برای گردش در سایت و یافتن محتوای مورد نظرشان نداشته باشند.

آیا شما از نقشه سایت استفاده می کنید؟

نقشه سایت همانطور که از نامش پیداست، لیستی از URL های وب سایت می باشد که پایشگرها می توانند از آن برای ایندکس محتوای وب سایت استفاده کنند. یکی از آسان ترین روش ها برای اطمینان از مشاهده صفحات از دید گوگل تهیه نقشه سایتی مطابق با استانداردهای گوگل و ثبت آن در گوگل سرچ کنسول است. با اینکه نقشه سایت به هیچ وجه جای ساختار صحیح سایت را نمی گیرد، اما به پایشگرها اجازه می دهد تا با سرعت بالاتری به محتوای سایت دسترسی داشته باشند.

نکته مهم در نقشه سایت

دقت داشته باشی که تنها صفحاتی را در نقشه سایت قرار دهید که قصد ایندکس شدن آنها را دارید. همینطور توجه کنید که دستورات واضحی در صفحه قرار داشته باشد. به عنوان مثال صفحات بلاک شده در robots.txt یا صفحات تکراری (مانند صفحاتی که با استفاده از تگ کانونیکال، تکراری معرفی شده اند) را در نقشه سایت قرار ندهید.

اگر وب سایت شما هیچ لینکی از خارج ندارد، ثبت نقشه سایت در گوگل سرچ کنسول به ایندکس شدن محتوا سرعت می بخشد. هیچ تضمینی برای این مسئله وجود ندارد، اما ارزش امتحان کردن را دارد.

آیا پایشگرها در هنگام دسترسی به یو آر ال ها با خطا مواجه می شوند؟

ربات ها در هنگام پایش وب سایت ممکن است با خطاهایی مواجه شوند. شما می توانید با رفتن به بخش Crawl Errors در گوگل سرچ کنسول از خطاهایی که احیانا ربات ها با آن برخورد کرد اند آگاه شوید. این خطاها غالبا از نوع خطاهای سروری و خطاهایی با موضوع پیدا نشدن محتوا هستند. فایل های log سرور گنجینه بی نظیری از این گزارش ها هستند، اما چون کار با آن برای مبتدیان کمی سخت است، بنابراین در اینجا به آن اشاره ای نمی کنیم.

قبل از اینکه کار مهمی در رابطه با خطاها انجام دهید، نیاز است که از معنای خطاهای سرور و خطاهای not found آگاه شوید.

کدهای 4xx: زمانی که پایشگرها به دلیل خطا در Client قادر به دسترسی به محتوا نیستند

خطاهای 404 بدین معنا هستند که یو آر ال درخواست شده دارای اشتباهات تایپی بوده و وب سایت قادر به ارائه محتوایی نیست. یکی از معروف ترین این نوع خطاها، خطای 404 – not found است. این خطا غالبا در مواقعی مانند یو آر ال اشتباه، پاک شدن صفحات یا ریدایرکت های غلط رخ می دهد. موتورهای جستجو قادر به درک صفحات دارای خطای 404 نبوده و کاربران نیز از مشاهده چنین نوع خطاهایی نا امید شده و سایت را ترک می کنند.

کدهای 5xx: زمانی که پایشگرها به دلیل خطا در سرور قادر به دسترسی به محتوا نیستند

خطاهای 5xx به معنای وجود مشکلی در سمت سرور است، به گونه ای که سرور قادر به پاسخگویی به درخواست موتورهای جستجو نیست. یکی از علت های شایع بروز این خطا، زمان زیاد پاسخ دهی به درخواست مرورگر است، بنابراین گوگل بات درخواست خود را رها می کند.

خوشبختانه راهکار خوبی برای اطلاع به موتورهای جستجو و کاربران در زمان انتقال صفحات به آدرسی دیگر وجود دارد. نام این راهکار ریدایرکت 301 است.

تصور کنید که آدرس صفحه example.com/young-dogs/ را به آدرس example.com/puppies/ تغییر داده اید. موتورهای جستجو و کاربران نیاز به پلی برای گذر از آدرس قدیمی به آدرس جدید دارند. نام این پل ریدایرکت 301 است.

{module ریدایرکت 301}

کد وضعیت 301 بدین معنیست که صفحه به طور دائمی به آدرس جدید نقل مکان کرده است، بنابراین از ریدایرکت صفحات قدیمی به صفحات نامرتبط خودداری کنید. اگر صفحه ای دارای رتبه بوده و شما آن را به صفحه غیر مرتبط دیگری ریدایرکت 301 کنید، مطمئنا دچار افت رتبه خواهید شد، چرا که صفحه جدید دارای محتوای قبلی یا محتوایی مرتبط با آن نیست.

مراقب زنجیره ریدایرکت ها باشید

اگر گوگل بات با زنجیره ای از ریدایرکت ها مواجه شود، رسیدن به صفحه نهایی برایش سخت خواهد شد. این سناریو معرف به زنجیره ریدایرکت بوده و گوگل پیشنهاد کرده که همواره طول زنجیر را محدود نگه دارید. به عنوان مثال اگر صفحه اول به صفحه دوم و صفحه دوم به صفحه سوم ریدایرکت می شود، بهتر است که مستقیما صفحه اول را به صفحه سوم ریدایرکت کنید.

پس از حصول اطمینان از پایش شدن صحیح وب سایت زمان آن است که از ایندکس شدن آن مطمئن شویم.

ایندکس کردن: چگونه موتورهای جستجو صفحات را تحلیل کرده و ذخیره سازی می نمایند؟

پس از اطمینان از پایش شدن وب سایت نوبت آن است که از ایندکس شدن آن مطمئن شویم. پایش شدن وب سایت و امکان خزیدن ربات های موتورهای جستجو در آن به منزله تایید ایندکس شدن آن در دیتابیس موتورهای جستجو نیست. در بخش قبلی به این بحث پرداختیم که موتورهای جستجو چگونه وب سایت ها را می یابند. ایندکس جاییست که صفحات وب نزد موتور های جستجو ذخیره می شوند. پایشگر ها پس از مشاهده صفحات، آن را همانند یک مرورگر رندر می کنند. آنها در طی این فرایند به آنالیز محتوای صفحه نیز می پردازند. سپس تمامی این اطلاعات در ایندکس ذخیره سازی می گردد.

آیا می توانم صفحات سایت را از دید پایشگرهای گوگل مشاهده کنم؟

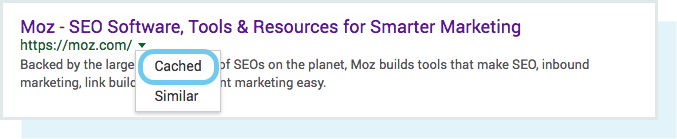

آری، نسخه کش شده صفحات وب سایت شما اسنپ شاتی از آخرین نسخه مشاهده شده توسط گوگل را نشان می دهد.

گوگل در بازه های زمانی متفاوتی به صفحات سایت سرکشی می کند. وب سایت هایی که تولید محتوای زیادی می کنند (مانند خبرگزاری ها) نسبت به وب سایت های کوچک تر، بیشتر و سریعتر پایش می شوند. نسخه کش شده صفحات را می توانید با کلیک بر روی گزینه Cached در نتایج جستجو مشاهده کنید.

آیا صفحات قادر به حذف شدن از ایندکس هستند؟

آری، صفحات وب می توانند از ایندکس پاک شوند. برخی از مهمترین دلایلی که منجر به چنین اتفاقی می شود عبارتند از:

- یو آر ال مورد نظر دارای خطای 404 یا خطای 500 شود. این مسئله می تواند سهوا اتفاق بیفتد. به عنوان مثال آدرس صفحه ای تغییر کرده و شما ریدایرکت 301 آن را فراموش کرده باشید.

- یوآر ال داری متا تگ noindex باشد. این متا تگ توسط مدیر سایت می تواند به صفحات اضافه شده و موتورهای جستجو نیز از آن پیروی می کنند.

- یو آر ال به خاطر تخطی از قوانین گوگل مورد جریمه قرار گیرد. در نتیجه از ایندکس پاک می شود.

- یو آر ال به خاطر وجود پسورد بر روی صفحه و قابل دسترس بودن تنهای برای کاربران دارای اکانت قابل نمایش است. در نتیجه از ایندکس گوگل پاک شده است.

اگر متوجه شدید که یکی از صفحات سایت بدون دلیلی در ایندکس گوگل قرار ندارد، می توانید از طریق ابزار URL Inspectation Tool گوگل سرچ کنسول استفاده کرده و آدرس مورد نظر خود را به صورت دستی در آن ثبت نمایید.

اعلام نحوه ایندکس سایت به موتورهای جستجو

دستورات متا robots

شما می توانید با استفاده از متا تگ robots به موتورهای جستجو اعلام نمایید که چگونه با صفحات سایت رفتار کنند. به عنوان مثال شما می توانید به موتورهای جستجو اعلام کنید که یک صفحه را ایندکس نکرده یا از اعتبار صفحه به لینک های آن چیزی منتقل نکنند. این دستورات از طریق متا تگ robots واقع در بخش <head> سایت یا تگ X-Robots در هدر HTTP اعمال می شوند.

متا تگ Robots

متا تگ Robots می تواند در قسمت <head> صفحات سایت مورد استفاده قرار گیرد. موتورهای جستجوی مد نظرمان نیز در این متا تگ قابل اشاره هستند. در ادامه مهمترین دستورات این متا تگ و شرایط استفاده از آن را بیان می کنیم:

index/noindex به موتورهای جستجو اعلام می کند که آیا صفحات در ایندکس آنها قرار گیرند یا نه. در صورت استفاده از noindex به موتورهای جستجو اعلام می کنید که نیازی به قرار گرفتن این صفحه در نتایج جستجو نیست. موتورهای جستجو به صورت پیشفرض صفحات را ایندکس می کنند، بنابراین نیازی به قرار دادن index در صفحات مهم سایت نیست.

- سناریو مورد استفاده: در شرایطی که در سایت شما صفحاتی وجود دارد که محتوای خاصی نداشته، اما در عین حال برای کاربران مورد استفاده است (مانند صفحات پروفایل کاربران) می توانید از noindex استفاده نمایید.

follow/nofollow به موتورهای جستجو اعلام می کنید که پایشگر به دنبال لینک های یک صفحه بروند یا نه. دستور Follow موجب دنبال کردن لینک های صفحه شده و موتورهای جستجو از اعتبار صفحه برای لینک های آن نیز خرج می کنند. در صورت استفاده از nofollow موتورهای جستجو لینک های صفحه را دنبال نکرده و اعتباری به این لینک ها منتقل نمی کنند. به صورت پیشفرض تمامی لینک ها برای موتورهای جستجو به چشم follow دیده می شوند.

- سناریو مورد استفاده: nofollow اغلب در کنار noindex استفاده شده و در صفحاتی به کار برده می شود که شما علاوه بر ایندکس نشدن یک صفحه، علاقه ای به دنبال شدن لینک های آن نیز ندارید.

noarchive برای عدم ذخیره سازی نسخه کش صفحه در موتورهای جستجو به کار برده می شود. به صورت پیش فرض موتورهای جستجو نسخه کش شده ای از صفحات سایت را ذخیره کرده و آن را از طریق گزینه Cached در نتایج جستجو قابل دسترس می کنند.

- سناریو مورد استفاده: در صورتی که وب سایت شما از نوع فروشگاه اینترنتیست و قیمت محصولات نیز مرتبا تغییر می کند، می توانید از تگ noarchive استفاده کرده تا کاربران قیمت های قبلی شما را مشاهده نکنند.

مثالی از تگ های noindex, nofollow به شکل زیر است:

<!DOCTYPE html>

<html>

<head>

<meta name=”robots” content=”noindex, nofollow” />

</head>

<body>…</body>

</html>

این مثال موتورهای جستجو را از ایندکس صفحات و دنبال کردن لینک های آن منع می کند. در صورتی که این دستور صرفا برای موتور جستجوی خاصیست، می توانید نام پایشگر (مانند googlebot) را در دستورات قید کنید.

تگ X-Robots

تگ x-robots در داخل هدر HTTP یو آر ال سایت قرار گرفته و انعطاف بیشتری در اختیار شما می گذارد. به عنوان مثال در صورت استفاده از regex، بلاک کردن فایل های غیر HTML ای یا نوایندکس کردن کل سایت این تگ کاربرد دارد.

به عنوان مثال می توانید کلیه آدرس های یک فولدر یا نوع خاصی از فایل ها را نو ایندکس نمایید:

<Files ~ “\/?no\-bake\/.*”>

Header set X-Robots-Tag “noindex, nofollow”

</Files>

یا اشاره به یک نوع فایل خاص مانند PDF:

<Files ~ “\.pdf$”>

Header set X-Robots-Tag “noindex, nofollow”

</Files>

نکته برای سایت های وردپرسی:

در مسیر پیشخوان > تنظیمات > خواندن وردپرس گزینه ای به نام ” از موتورهای جستجو درخواست کن تا محتوای سایت را بررسی نکنند” وجود دارد. دقت داشته باشید که این گزینه پس از راه اندازی سایت تیک نخورده باشد. خوردن این تیک موجب می شود که موتورهای جستجو به خاطر دستورات robots.txt به سایت شما مراجعه نکنند.

درک صحیح روش های مختلف تاثیر گذار بر روی رفتار موتورهای جستجو به شما کمک می کند تا از انجام اشتباهات در آینده و جلوگیری از ایندکس نشدن صفحات مهم سایت خودداری کنید.

رتبه بندی: موتورهای جستجو چگونه یو آر ال ها را رتبه بندی می کنند؟

موتورهای جستجو چگونه می توانند از نمایش نتایج مرتبط با عبارت جستجو شده اطمینان حاصل کنند؟ نام فرایندی که این کار را به شکل صحیح انجام میدهد، رتبه بندیست. به عبارتی دیگر موتورهای جستجو نتایج جستجو را به ترتیب اهمیت از زیاد به کم مرتب می کنند.

موتورهای جستجو برای تشخیص میزان مرتبط بودن از الگوریتم هایی استفاده می کنند. الگوریتم ها فرمول هایی هستند که موجب رتبه بندی نتایج جستجو بر اساس کیفیتشان می شوند. این الگوریتم ها در جهت افزایش کیفیت نتایج جستجو سالانه به دفعات زیادی تغییر می کنند. به عنوان مثال گوگل هر روز تنظیمات الگوریتم ها را به نحوی تغییر می دهد، به طوری که برخی از آنها کوچک بوده و برخی دیگر نیز شامل تغییر در هسته الگوریتم ها هستند. برای مشاهده این الگوریتم ها صفحه تاریخچه الگوریتم های گوگل را مشاهده نمایید. در این صفحه لیستی از تغییرات مهم گوگل از سال 2000 را مشاهده می کنید.

حال چرا اصلا الگوریتم های گوگل تغییر می کنند؟ هدف گوگل از تغییرات، ارتقا کیفیت نتایج جستجوست. در صورتی که بر اثر تغییرات الگوریتم های گوگل افت رتبه شدید داشته اید بایستی دستورالعمل های گوگل که به شکل های Google’s Quality Guidelines یا Search Quality Rater Guidelines به تحریر درامده اند را مطالعه کنید تا متوجه شوید که در کجای کار اشتباه کرده اید.

موتورهای جستجو چه می خواهند؟

موتورهای جستجو همیشه یک چیز از ما می خواهند: ارائه بهترین پاسخ ها به سوالات کاربران در فرمتی مناسب. اما اگر اینطور است، چرا سئو نسبت به سال های دور تغییر کرده است؟

تصور کنید که فردی قصد یادگیری زبان جدید دارد. در ابتدا یادگیری او از زبان جدید بسیار ابتداییست. در طول زمان این یادگیری شکل عمیق تری به خود گرفته و شخص با مفاهیم آشنا می شود. به عبارتی او به درک معانی پشت کلمات پرداخته و رابطه بین عبارت را می فهمد. اینجاست که با تمرین بیشتر فرد می تواند نکات ظریف زبان جدید را متوجه شده و قادر به پاسخگویی به سوالات مبهم نیز می گردد.

زمانی که موتورهای جستجو شروع به یادگیری زبان ما کردند، فریب آنها بسیار ساده بود و وبمسترها می توانستند بر خلاف دستورالعمل های آنها اقدام به کارهایی کنند که نتیجه مثبتی برای آنها به همراه داشته باشد. به عنوان مثال استفاده زیاد از یک کلمه کلیدی، جز این روش ها بود. وبمسترها کافی بود که برای کسب رتبه در یک کلمه کلیدی، آن را به دفعات زیاد در متن صفحه تکرار کنند.

این تاکتیک موجب تجربه کاربری بسیار ضعیفی شده و کاربران به جای کسب پاسخ سوالشان، با یک مشت جملات تکراری و ناخوانا رو به رو شوند. این روش در گذشته جواب می داد، در حالی که هیچ وقت موتورهای جستجو آن را نمی خواستند.

نقش لینک ها در سئو

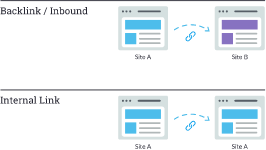

وقتی صحبت از لینک می شود، دو معنی در ذهن ما ایجاد می گردد. یکی بک لینک است که به معنی لینکی به سایت شما از سایتی دیگر می باشد. دیگری لینک داخلی است که به معنای لینکی از سایت شما به صفحه دیگری از سایتتان می باشد.

لینک ها جز با سابقه ترین پارامترها در سئو هستند. از گذشته تا به حال موتورهای جستجو به دنبال پارامترهایی بوده اند که میزان اعتبار صفحات مختلف را با یکدیگر مقایسه کنند. محاسبه تعداد بک لینک های یک سایت عامل مهمی در ارزیابی پارامتر اعتبار بود.

کارایی بک لینک ها مشابه با مسائل دنیای روزمره ما نیز هستند. به عنوان مثال کافی شاپی فرضی با نام مستر کافه را در نظر بگیرید.

- تایید از طرف دیگران = نشانه خوبی از اعتبار

مثال: بسیاری از افراد مختلف شهر تایید کرده اند که مستر کافه بهترین کافی شاپ شهر است.

- تایید از طرف خود = جانبدارانه، نشانه خوبی برای اعتبار نیست

مثال: مدیر کافی شاپ مستر کافه اعلام می کند که کافی شاپ او بهترین در شهر است.

- تایید از طرف افراد غیر موجه: اصلا نشانه خوبی از بابت اعتبار کافی شاپ نبوده و حتی ممکن است به عنوان به یک نشانه منفی دیده شود

مثال: مدیر کافی شاپ به افرادی که حتی یک بار از کافی شاپ او بازدید نکرده اند پول پرداخت کرده تا از این مکان تعریف و تمجید کنند.

- بدون تایید: اعتبار نا مشخص

مثال: کافی شاپ مستر کافه ممکن است که بسیار خوب باشد، اما شما هنوز فردی را نیافته اید که نظری در این باره داشته باشد.

اینجا بود که مفهومی به نام پیج رنک خلق شد. پیج رنکی جزیی از الگوریتم گوگل به شمار می رود که با لینک ها در ارتباط بوده و توسط یکی از موسسین گوگل، آقای لری پیج معرفی شد. پیج رنک اهمیت یک وب سایت را با توجه به کمیت و کیفیت بک لینک های آن ارزیابی می کند. در این رابطه این طور فرض می شود که هر چه یک صفحه دارای اهمیت، اطلاعات و اعتبار بیشتری باشد، لینک های داده شده به آن نیز بیشتر خواهد بود.

هر چه بک لینک های طبیعی سایت شما از سایت های معتبر بیشتر باشد، احتمال کسب رتبه بالاتر افزایش خواهد یافت.

نقش محتوا در سئو

لینک ها بدون اشاره به محتوا ارزش نخواهند داشت. محتوا چیزی فراتر از کلمات است. در واقع محتوا هر چیزیست که توسط کاربران استفاده می شود (مانند ویدئو، تصویر و صد البته متن). اگر موتورهای جستجو به منزله ماشین های پاسخگویی هستند، محتوا همان چیزیست که آنها به عنوان پاسخ به کاربران ارائه می دهند.

زمانی که کاربر دست به جستجو می زند، هزاران نتیجه محتمل برای آن وجود خواهد داشت، اما چگونه موتورهای جستجو از بین این همه نتیجه، آنهایی که با ارزش ترند را انتخاب می کنند؟ یکی از مهمترین عوامل کسب رتبه برای صفحه ای از سایت شما اینست که محتوای آن صفحه چقدر در راستای نیاز کاربران می باشد. به عبارت دیگر آیا این صفحه با عبارت جستجو شده در ارتباط بوده و همان چیزیست که کاربر به دنبال آن است؟

به خاطر تمرکز موتورهای جستجو بر روی رضایت کاربران است که معیارهایی مانند طول محتوا، تعداد تکرار کلمات کلیدی یا تیترها (تگ های هدر) آنطور که تصور می شود به صورت غالبی بر روی رتبه بندی موثر نیستند. همه این پارامترها می توانند بر روی نتایج جستجو تاثیر بگذارند، اما تمرکز شما بایستی بر روی کاربری باشد که به دنبال محتوا و خواندن آن است.

امروزه هزاران فاکتور رتبه بندی وجود دارد، اما از این بین سه مورد آنها از بقیه نسبتا مهمتر هستند، بک لینک های وب سایت، محتوای وب سایت و رنک برین.

رنک برین چیست؟

رنک برین (RankBrain) بخش یادگیری ماشینی الگوریتم اصلی گوگل است. یادگیری ماشینی نرم افزاری کامپیوتریست که پیش بینی های خود را در طول زمان بر اساس مشاهدات و آموزش خود ارتقا می هد. موتورهای جستجو به خاطر همین سیستم یادگیریست که هر روز در حال ارتقا خود هستند.

به عنوان مثال اگر رنک برین متوجه شود که آیتم چهارم نتیجه جستجو به ازای یک عبارت مشخص، نتیجه بهتری برای کاربران نسبت به آیتم های بالایی باشد، آیتم چهارم را در صدر نتایج جستجو قرار می دهد.

در مورد رنک برین نیز مانند موتورهای جستجو، ما نمی دانیم که این سیستم دقیقا چگونه کار کرده و چه عواملی و با چه با وزنی بر روی آن تاثیر گذار است.

این مسئله در سئو چه معنایی دارد؟

گوگل به واسطه رنک برین نتایج مرتبط تر و با ارزش تری را به کاربران نمایش می دهد و از این رو نیاز است که ما تمرکز بیشتری بر روی نیاز اصلی کاربران کنیم. بهترین پاسخ و اطلاعات را برای کاربران جستجو کننده ارائه دهید. تنها بدین شکل است که می توانید در دنیای رنک برین به موفقیت دست یابید.

معیار های مشارکت

منظور از معیارهای مشارکت، داده هاییست که مرتبط با چگونگی تعامل کاربرانی از وب سایت شماست که از طریق موتورهای جستجو وارد سایت شما شده اند. از این گونه معیار ها می توان به موارد زیر اشاره کرد:

- کلیک (بر روی سایت در صفحه نتایج جستجو)

- زمان حضور در صفحه (مدت زمان حضور کاربران در صفحه قبل از ترک آن)

- بانس ریت یا نرخ پرش (درصدی از کاربران که تنها یک صفحه از سایت را بازدید کرده اند)

- پوگو استیکینگ (کلیک بر روی وب سایت شما در نتایج جستجو و ترک سریع آن و سپس کلیک بر روی سایتی دیگر در نتایج جستجو)

بسیاری از تست ها نشان می دهند که بین معیارهای مشارکت و رتبه بالاتر ارتباط وجود دارد، اما رابطه دقیق علت و معلولی آن نامشخص است. آیا معیار های با کیفیت مشارکت می تواند نشانی از یک سایت با رتبه بالا باشد؟ یا آیا سایتی که رتبه خوبی کسب کرده، الزاما دارای معیارهای مشارکت با کیفتیست؟

بیانیه گوگل در این باره

با اینکه گوگل از این معیارها به عنوان فاکتور مستقیم رتبه بندی نام نبرده است، اما اعلام کرده که از داده های مرتبط با رفتار کاربران در صفحه نتایج جستجو برای نتایج برخی از جستجوها استفاده می کند. طبق گفته Udi Manber، مدیر سابق گوگل در بخش کیفیت جستجو، رتبه سایت ها تاثیر کلیک ها قرار داد. اگر آنها در مشاهداتی متوجه شوند که در جستجوی یک عبارت خاص، 90% کاربران بر روی آیتم دوم و تنها 10 درصد بر روی آیتم اول کلیک می کنند، نتیجه این خواهد شد که جای آیتم اول و دوم با یکدیگر عوض خواهد شد.

یکی از دیگر از مهندسین گوگل با نام Edmond Lau این مسئله را بدین شکل تایید کرده است:

“کاملا واضح است که موتورهای جستجو از داده های مرتبط با کلیک در نتایج جستجو فیدبک بگیرند. مکانیزم استفاده از این داده ها به طور اختصاصی نزد گوگل است، اما واضح است که گوگل به شکلی از این داده ها در سیستم رتبه بندی استفاده می کند.”

گوگل همواره سعی در ارتقا کیفیت نتایج جستجو دارد و در نتیجه استفاده آنها از این گونه داده ها، اجتناب ناپذیر به نظر می رسد. اما گوگل از این پارامتر خیلی به عنوان فاکتور رتبه بندی استفاده نمی کند و صرفا از آن در ارتقا نتایج نهایی جستجو بهره میبرد.

چیزهایی که تست ها تایید کرده اند

تست های مختلفی تایید کرده اند که گوگل از نحوه رفتار کاربران در تنظیم رتبه آیتم های نتایج جستجو استفاده می کند:

- تست آقای Rand Fishkin در سال 2014 نشان داده که تنها 200 کلیک کاربران بر روی نتایج جستجو موجب ارتقا رتبه سایت مد نظر او از رتبه هفت به یک شده است. به طرز جالبی افزایش رتبه این سایت مختص مکانی بود که غالب کاربران کلیک کننده از آنجا بودند. در این تست کاربران از کشور آمریکا بودند و مشاهده شد که رتبه سایت در جستجوی کاربران آمریکایی ارتقا زیادی داشته است، در حالی که رتبه سایت در دیگر کشورها تغییر محسوسی نداشت.

- مقایسه Larry Kim درباره صفحات مهم سایتش نشان می دهد که الگوریتم یادگیری ماشینی گوگل موجب افت رتبه سایت در کلمات کلیدی شده است که کاربران زمان زیادی را در صفحه فرود آن کلمه کلیدی سپری نمی کنند.

- تست Darren Shaw نشان داده است که رفتار کاربران بر روی نتایج محلی و نتایجی که در قالب نقشه ارائه می شوند، تاثیر گذار است.

از آنجا که معیار های مشارکت کاربران به طور واضحی بر روی تغیر رتبه سایت ها در نتایج جستجو تاثیر گذار است، می توان گفت که متخصصین سئو بایستی به بهینه سازی معیارهای مشارکت بپردازند. از دید رتبه بندی معیار های مشارکت مانند ابزارهای کنترل کیفیت هستند. فاکتورهای مانند محتوا و بک لینک رتبه سایت ها را تعیین کرده و سپس گوگل از این معیار های مشارکت برای تصحیح رتبه سایت در صفحه اول نتایج جستجو استفاده می کند.

سیر تکاملی نتایج جستجو

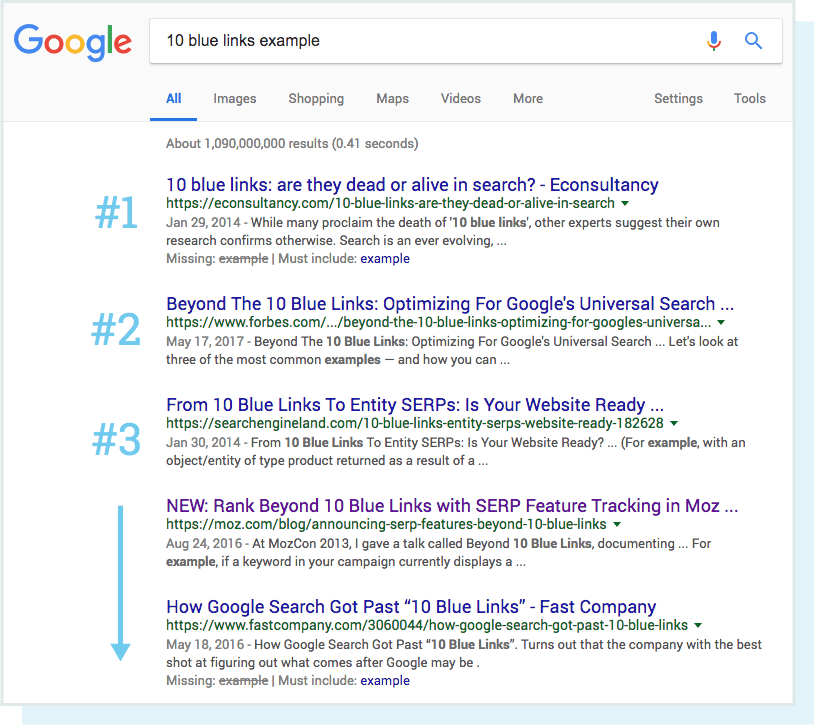

در گذشته های دور نتایج جستجوی گوگل به ازای هر عبارتی، یک صفحه شامل لیستی از ده آیتم می شد. فرمت این صفحه نیز همیشه یکسان بود.

در این ابعاد کسب رتبه یک گوگل، نتیجه ای فوق العاده محسوب می شد. اما بعد ها اتفاقی افتاد. گوگل شروع به اضافه کردن فرمت های جدیدی به نتایج جستجو نمود. این نتایج تحت نام SERP features شناخته می شوند.

برخی از این امکانات عبارتند از:

- تبلیغ های پولی

- فیچر اسنیپت (Featured snippets)

- جعبه هایی بانام People Also Ask

- پک لوکال (Local pack)

- پنل دانش (Knowledge panel)

- سایت لینک ها (Sitelinks)

گوگل همواره در حال اضافه کردن آیتم های جدید به این قسمت است. آنها حتی دست به خلق نتایج جستجو با صفر آیتم (zero-result SERPs) زده اند. در این گونه جستجوها تنها یک بخش به همراه اطلاعاتی نمایش داده شده و کاربران زیر آن نتیجه دیگری مشاهده نمی کنند. برای مشاهده دیگر سایت ها بایستی بر روی گزینه ای با عنوان view more results کلیک کنید.

اضافه کردن چنین ویژگی هایی موجب هراس وبمسترها به دو دلیل شده است. بسیاری از این ویژگی ها موجب پایین راندن نتایج ارگانیک می شوند. دیگر تاثیر این ویژگی ها کلیک کمتر بر روی نتایج جستجوست، چرا که پاسخ بسیاری از سوالات در نتایج جستجو مشاهده شده و کاربر نیازی به کلیک بر روی سایت منبع احساس نمی کند.

اما گوگل چرا دست به چنین اقدامی زده است؟ همه چیز به تجربه کاربری بر می گردد. رفتار کاربران به این مسئله اشاره داشته است که آنها در جستجوی برخی آیتم ها از مشاهده فرمت هایی خاص رضایت بیشتری داشته اند. توجه کنید که چگونه برخی از این ویژگی های گوگل با نوع جستجوها همخوانی دارند.

{module query intents}

پس بسیار مهم است که بدانیم پاسخ ها می توانند به فرمت های مختلفی ارائه شوند و چگونگی ساختار بندی محتوای شما می تواند در نوع نمایش سایت در نتایج جستجو تاثیر گذار باشد.

جستجوی مبتنی بر مکان

موتور جستجویی مانند گوگل دارای ایندکسی از کسب و کارهای محلیست که موجب نمایش نتایج محلی می شود. اگر کسب و کار شما کسب و کاری دارای مکانی مشخص برای مراجعه مشتریان (مانند دندان پزشکی) است یا اینکه شما بایستی به عنوان متخصصص به مکان کاربر مراجعه کنید (مانند لوله کش) بایستی کسب و کار خود را در نقشه گوگل ثبت نمایید.

گوگل در هنگام نمایش نتایج محلی از فاکتورهای رتبه بندی زیر استفاده می کند:

- ارتباط

- مسافت

- برتری

ارتباط

منظور از این پارامتر میزان ارتباط کسب و کار محلی با عبارت جستجو شده است. برای اطمینان از اینکه کسب و کارتان به درستی ثبت شده و مرتبط با جستجوی کاربران است، اطلاعات آن را چک کنید.

مسافت

گوگل از مکان فیزیکی شما برای نمایش نتایج بهتر استفاده می کند. نتایج محلی به شدت تحت تاثیر پارامتر فاصله هستند. بدین معنی که فاصله مکان کاربر جستجو کننده تا مکان کسب و کار، فاکتور مهمی از دید گوگل است. همچنین اگر کاربر در جستجوی خود نام مکان را نیز ذکر کند، نزدیکی مکان شما به مکان اشاره شده توسط کاربر، اهمیت زیادی خواهد داشت.

برتری

گوگل در جستجوهای محلی سعی می کند که به کسب و کارهایی شناخته شده و دارای برتری نسبت به سایرین بهای بیشتری دهد. گوگل برای ارزیابی این مورد از فاکتورهای زیر استفاده می کند:

نقد ها

تعداد نقدها و همینطور حس مثبت بیشتر آنها در بخش نقد های گوگل می تواند بر روی رتبه کسب و کار در نتایج محلی تاثیر گذار باشد.

نقل قول ها

منظور نقل قول هاییست که از نام برند، شماره تماس یا آدرس آن در پلتفرم های آنلاین می شود. گوگل در شرایطی که اطلاعات مربوط به یک کسب و کار را به دفعات در ایندکس خود ببیند، آن کسب و کار را کسب و کاری معتبر تصور می کند. همچنین تکرار آدرس یک کسب و کار به دفعات، نشان از صحیح بودن آدرس آن دارد. در حالت کلی این اطلاعات موجب می شود که گوگل یک کسب و کار را با اعتماد بیشتری به کاربران نمایش دهد.

رتبه ارگانیک

سئو وب سایت کسب و کار بر روی سئو محلی آن نیز تاثیر گذار است. گوگل رتبه ارگانیک وب سایت را در نمایش آن در نتایج محلی در نظر می گیرد. در قسمت چهارم با فاکتورهای سئو داخلی آشنا خواهید شد. این فاکتورها به گوگل کمک می کنند تا درک بهتری از محتوای سایت داشته باشند.

فاکتورهای مشارکت محلی

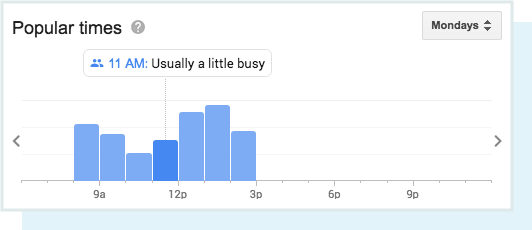

اگر چه این موضوع توسط گوگل به عنوان فاکتور رتبه بندی مطرح نشده است، اما تجربه نشان داده که نقش فاکتورهای مرتبط با مشارکت کاربران در طول زمان افزایش یافته است. گوگل سعی دارد که نتایج محلی را نسبت به گذشته پر بارتر کند. به عنوان مثال گوگل از داده های دنیای واقعی مانند زمان های مراجعه به کسب و کارها یا طول زمان مشاهده آیتم کسب و کار در این راستا استفاده می نماید.

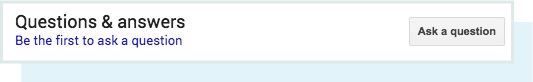

همچینی گوگل به کاربران اجازه میدهد که پرسش های خود را از کسب و کارها بپرسند:

بدون شک نتایج محلی امروزه بیشتر تحت تاثیر داده های دنیای واقعیست. این تعامل با نحوه فعل و انفعال کاربران و پاسخ آنها به کسب و کارهای محلی وابسته است، به جای اینکه گوگل صرفا به داده های سنتی مانند لینک و نقل قول که کاملا قابل شبیه سازی هستند بسنده کند.

از آنجا که گوگل علاقه مند به نمایش بهترین نتایج است، کاملا منطقیست که از داده های این چنینی برای ارزیابی کیفیت و میزان ارتباط کسب و کار ها با عبارت مورد جستجو استفاده کند.

نیازی نیست که شما به طور 100% از الگوریتم گوگل آگاه شوید. واقعیت آنست که بیشتر بخش های این الگوریتم مانند یک راز باقی مانده است. اما با توجه به این اطلاعات، دانش کافی و اولیه از نحوه کار موتورهای جستجو، شیوه درک آنها، نحوه ذخیره سازی و رتبه بندی محتوا را کسب کرده اید.

پاسخی بگذارید