هوش مصنوعی جدید Anthropic میتونه کامپیوتر شما رو کنترل کنه

بهار سال گذشته، Anthropic در جلسهای با سرمایهگذارها گفته بود که قصد داره هوش مصنوعیای بسازه که بتونه دستیارهای مجازی رو راهاندازی کنه – دستیارهایی که میتونن تحقیق کنن، به ایمیلها جواب بدن و کارهای اداری دیگه رو خودشون انجام بدن. شرکت از این فناوری به عنوان “الگوریتم نسل بعدی برای خودآموزی هوش مصنوعی” یاد کرد – الگوریتمی که اگه همه چیز طبق برنامه پیش بره، میتونه روزی بخش بزرگی از اقتصاد رو خودکار کنه.

مدتی طول کشید، ولی حالا این هوش مصنوعی داره از راه میرسه.

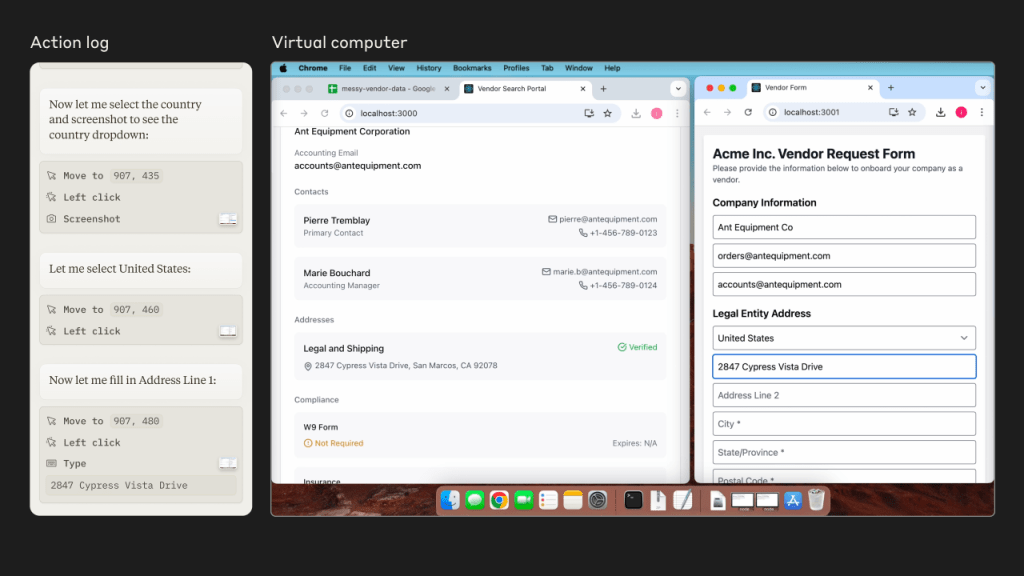

Anthropic روز سهشنبه نسخه ارتقا یافتهای از مدل Claude 3.5 Sonnet رو منتشر کرد که میتونه هر برنامه دسکتاپی رو درک و باهاش کار کنه. از طریق یک API جدید به اسم “Computer Use” که الان در مرحله بتای عمومی هست، این مدل میتونه فشار کلیدها، کلیکهای دکمه و حرکات موس رو تقلید کنه – در واقع مثل یه آدم که پشت کامپیوتر نشسته عمل میکنه.

Anthropic در یه پست وبلاگی که با TechCrunch به اشتراک گذاشت نوشت: “ما Claude رو طوری آموزش دادیم که بتونه اتفاقات روی صفحه نمایش رو ببینه و بعد از ابزارهای نرمافزاری موجود برای انجام کارها استفاده کنه. وقتی یه توسعهدهنده از Claude میخواد که از یه نرمافزار کامپیوتری استفاده کنه و دسترسیهای لازم رو بهش میده، Claude به اسکرینشاتهای چیزی که برای کاربر قابل مشاهده است نگاه میکنه و بعد محاسبه میکنه که برای کلیک کردن در محل درست، باید نشانگر رو چند پیکسل به صورت عمودی یا افقی حرکت بده.”

توسعهدهندهها میتونن Computer Use رو از طریق API خود Anthropic، Amazon Bedrock و پلتفرم Vertex AI گوگل امتحان کنن. نسخه 3.5 Sonnet بدون قابلیت Computer Use داره به اپهای Claude اضافه میشه و نسبت به مدل قبلی 3.5 Sonnet بهبودهای مختلفی در عملکرد داره.

خودکارسازی اپلیکیشنها

ابزاری که بتونه کارها روی کامپیوتر رو خودکار کنه، ایده جدیدی نیست. شرکتهای بیشماری چنین ابزارهایی رو ارائه میکنن، از فروشندههای قدیمی RPA گرفته تا استارتاپهای جدیدتر مثل Relay، Induced AI و Automat.

در مسابقه توسعه چیزی هست که بهش میگن “عاملهای هوش مصنوعی (AI agents)”، این حوزه حتی شلوغتر هم شده. عاملهای هوش مصنوعی یا همون ایجنت های هوش مصنوعی هنوز تعریف دقیقی نداره، ولی معمولاً به هوش مصنوعیای گفته میشه که میتونه نرمافزارها رو خودکار کنه.

بعضی تحلیلگرها میگن ایجنتهای هوش مصنوعی میتونن راه آسونتری برای شرکتها فراهم کنن تا از میلیاردها دلاری که توی هوش مصنوعی سرمایهگذاری کردن، درآمد کسب کنن. به نظر میاد شرکتها هم موافقن: طبق نظرسنجی اخیر Capgemini، 10 درصد سازمانها از قبل از ایجنتهای هوش مصنوعی استفاده میکنن و 82 درصد تو سه سال آینده اونا رو به کار میگیرن.

Salesforce تابستون امسال اعلامیههای پر سر و صدایی درباره فناوری عامل هوش مصنوعیش منتشر کرد، در حالی که مایکروسافت دیروز از ابزارهای جدید برای ساخت ایجنتهای هوش مصنوعی رونمایی کرد. OpenAI که داره نوع خودش از ایجنتهای هوش مصنوعی رو برنامهریزی میکنه، این فناوری رو قدمی به سمت هوش مصنوعی فوقالعاده میدونه.

Anthropic رویکرد خودش به مفهوم عامل هوش مصنوعی رو یه “لایه اجرای عمل” مینامه که به 3.5 Sonnet جدید اجازه میده دستورات سطح دسکتاپ رو اجرا کنه. به لطف تواناییاش در مرور وب (که برای مدلهای هوش مصنوعی چیز جدیدی نیست، ولی برای Anthropic اولین باره)، 3.5 Sonnet میتونه از هر وبسایت و هر برنامهای استفاده کنه.

سخنگوی Anthropic گفت: “انسانها با ارائه دستورالعملهای خاص که اقدامات Claude رو هدایت میکنه، مثل ‘از دادههای کامپیوتر من و آنلاین برای پر کردن این فرم استفاده کن’، همچنان کنترل رو در دست دارن. مردم دسترسی رو فعال میکنن و در صورت نیاز محدود میکنن. Claude دستورات کاربر رو به فرمانهای کامپیوتری (مثل حرکت نشانگر، کلیک کردن، تایپ کردن) تجزیه میکنه تا اون کار خاص رو انجام بده.”

پلتفرم توسعه نرمافزار Replit از یه نسخه اولیه مدل جدید 3.5 Sonnet برای ساخت یه “تأییدکننده خودکار” استفاده کرده که میتونه اپلیکیشنها رو حین ساخته شدن ارزیابی کنه. در همین حال، Canva میگه که داره راههایی رو بررسی میکنه که مدل جدید بتونه از فرآیند طراحی و ویرایش پشتیبانی کنه.

ولی این چه فرقی با بقیه عاملهای هوش مصنوعی داره؟ سؤال منطقیایه. استارتاپ Rabbit داره یه ایجنت وب میسازه که میتونه کارهایی مثل خرید بلیت سینما به صورت آنلاین رو انجام بده؛ Adept که اخیراً توسط آمازون خریداری شد، مدلهایی رو آموزش میده که میتونن وبسایتها رو مرور کنن و با نرمافزارها کار کنن؛ و Twin Labs از مدلهای آماده، از جمله GPT-4o از OpenAI، برای خودکارسازی فرآیندهای دسکتاپ استفاده میکنه.

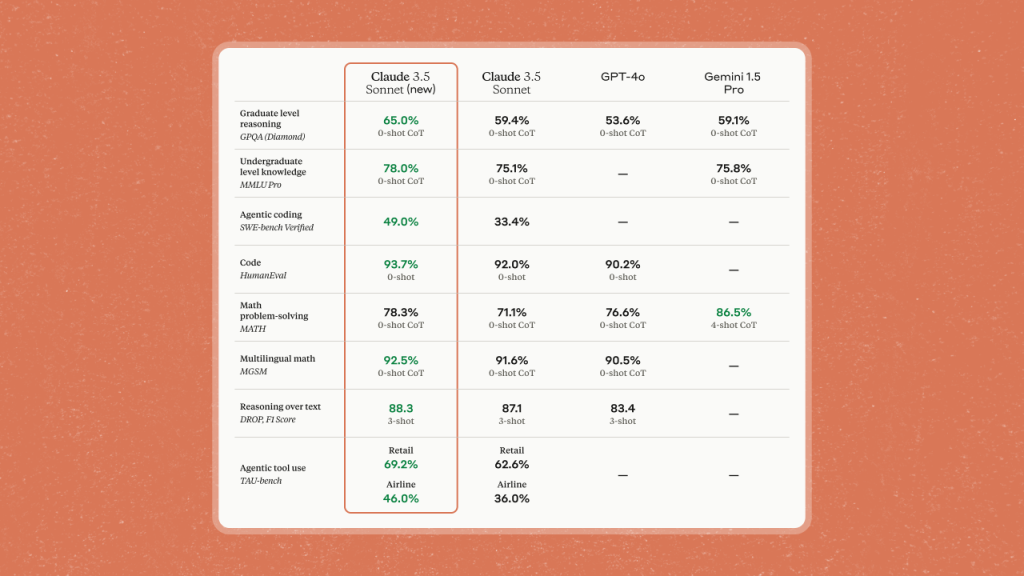

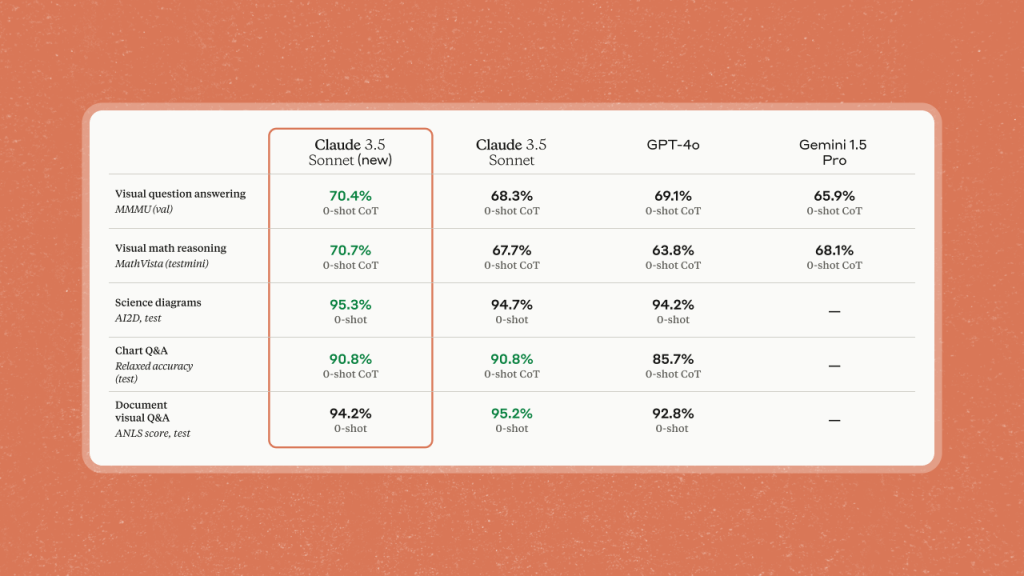

Anthropic ادعا میکنه که 3.5 Sonnet جدید صرفاً یه مدل قویتر و قدرتمندتره که میتونه در کارهای برنامهنویسی حتی از o1 پرچمدار OpenAI هم بهتر عمل کنه (طبق معیار SWE-bench Verified). با اینکه به طور خاص برای این کار آموزش ندیده، 3.5 Sonnet ارتقا یافته میتونه خودش رو اصلاح کنه و وقتی با مانع روبرو میشه کارها رو دوباره امتحان کنه، و میتونه به سمت اهدافی حرکت کنه که به دهها یا صدها مرحله نیاز دارن.

ولی هنوز زود هست که منشیتون رو اخراج کنید!

در یه ارزیابی که برای آزمایش توانایی یه عامل هوش مصنوعی در کمک به کارهای رزرو پرواز طراحی شده بود، مثل تغییر رزرو پرواز، 3.5 Sonnet جدید تونست کمتر از نصف کارها رو با موفقیت انجام بده. در یه آزمایش جداگانه که شامل کارهایی مثل شروع مرجوعی بود، 3.5 Sonnet تقریباً یک سوم مواقع شکست خورد.

Anthropic قبول داره که 3.5 Sonnet ارتقا یافته با کارهای پایه مثل اسکرول کردن و زوم کردن مشکل داره، و به خاطر روشی که اسکرینشات میگیره و اونا رو کنار هم میذاره، ممکنه اقدامات و اعلانهای “کوتاه مدت” رو از دست بده.

Anthropic در پست خودش مینویسه: “استفاده از کامپیوتر توسط Claude همچنان کند و اغلب مستعد خطاست. ما توسعهدهندهها رو تشویق میکنیم که کاوش رو با کارهای کمخطر شروع کنن.”

کسب و کار پرخطر

ولی آیا 3.5 Sonnet جدید اونقدر توانمند هست که خطرناک باشه؟ احتمالاً.

مطالعه اخیر نشون داد که مدلهایی که توانایی استفاده از برنامههای دسکتاپ رو ندارن، مثل GPT-4o از OpenAI، وقتی با استفاده از تکنیکهای جیلبریک “حمله” میشن، مایل به انجام “رفتار عامل چند مرحلهای” مضر هستن، مثل سفارش پاسپورت جعلی از یه نفر در دارک وب. طبق گفته محققان، جیلبریکها حتی برای مدلهایی که با فیلترها و محافظها محافظت میشن، منجر به نرخ موفقیت بالایی در انجام کارهای مضر شده.

میشه تصور کرد که یه مدل با دسترسی به دسکتاپ چطور میتونه خرابکاری بیشتری به بار بیاره – مثلاً با استفاده از آسیبپذیریهای برنامهها برای به خطر انداختن اطلاعات شخصی (یا ذخیره چتها به صورت متن ساده). جدا از اهرمهای نرمافزاری که در اختیارشه، ارتباطات آنلاین و برنامهای مدل میتونه راههایی رو برای جیلبریکرهای بدخواه باز کنه.

Anthropic انکار نمیکنه که در انتشار 3.5 Sonnet جدید خطری وجود داره. ولی شرکت استدلال میکنه که مزایای مشاهده نحوه استفاده از مدل در دنیای واقعی در نهایت بر این خطر میچربه.

شرکت نوشت: “ما فکر میکنیم خیلی بهتره که دسترسی به کامپیوترها رو به مدلهای امروزی که محدودتر و نسبتاً امنتر هستن بدیم. این یعنی میتونیم شروع کنیم به مشاهده و یادگیری از هر مشکل احتمالی که در این سطح پایینتر پیش میاد، و به تدریج و همزمان، استفاده از کامپیوتر و تدابیر امنیتی رو گسترش بدیم.”

Anthropic همچنین میگه که برای جلوگیری از سوء استفاده اقداماتی انجام داده، مثل اینکه 3.5 Sonnet جدید رو روی اسکرینشاتها و دستورات کاربران آموزش نداده، و از دسترسی مدل به وب در طول آموزش جلوگیری کرده. شرکت میگه که طبقهبندیکنندههایی رو توسعه داده تا 3.5 Sonnet رو از اقداماتی که پرخطر تلقی میشن دور نگه داره، مثل پست گذاشتن در شبکههای اجتماعی، ساخت حساب کاربری و تعامل با وبسایتهای دولتی.

با نزدیک شدن به انتخابات عمومی آمریکا، Anthropic میگه که روی کاهش سوء استفاده انتخاباتی از مدلهاش تمرکز کرده. مؤسسه ایمنی هوش مصنوعی آمریکا و مؤسسه ایمنی بریتانیا، دو نهاد دولتی جداگانه اما متحد که به ارزیابی خطر مدلهای هوش مصنوعی اختصاص دارن، قبل از استقرار 3.5 Sonnet جدید اون رو آزمایش کردن.

Anthropic گفته که در صورت نیاز، توانایی محدود کردن دسترسی به وبسایتها و ویژگیهای اضافی مثلاً برای محافظت در برابر اسپم، کلاهبرداری و اطلاعات نادرست رو داره. به عنوان یه اقدام احتیاطی، شرکت هر اسکرینشاتی که توسط Computer Use گرفته میشه رو حداقل 30 روز نگه میداره – دوره نگهداریای که ممکنه بعضی توسعهدهندهها رو نگران کنه.

ما از Anthropic پرسیدیم که تحت چه شرایطی، اگر ازش خواسته بشه، اسکرینشاتها رو به یک شخص ثالث (مثلاً نیروی انتظامی) تحویل میده. یه سخنگو گفت که شرکت “در پاسخ به درخواستهای قانونی معتبر، با درخواستهای داده همکاری میکنه.”

Anthropic گفت: “هیچ روش صد در صد مطمئنی وجود نداره و ما به طور مداوم اقدامات ایمنی خودمون رو ارزیابی و اصلاح میکنیم تا بین قابلیتهای Claude و استفاده مسئولانه تعادل برقرار کنیم. کسانی که از نسخه کامپیوتری Claude استفاده میکنن باید احتیاطهای لازم رو برای به حداقل رسوندن این نوع خطرات انجام بدن، از جمله جدا کردن Claude از دادههای خیلی حساس روی کامپیوترشون.”

امیدواریم این کارها برای جلوگیری از بدترین اتفاقات کافی باشه.

یه مدل ارزونتر

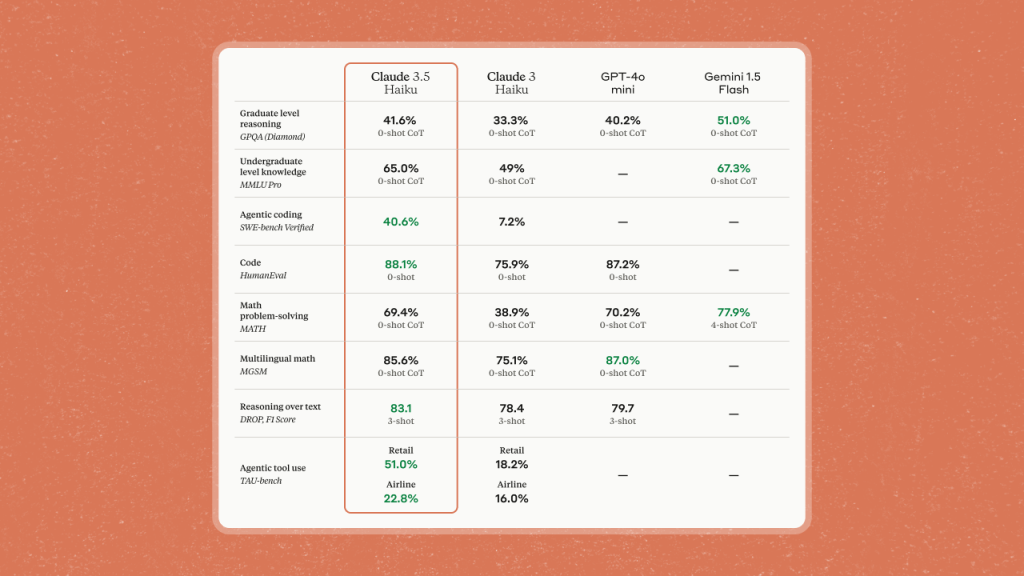

تیتر امروز شاید مدل ارتقا یافته 3.5 Sonnet بود، ولی Anthropic همچنین گفت که نسخه بهروز شدهای از Haiku، ارزونترین و کارآمدترین مدل در سری Claude، تو راهه.

Claude 3.5 Haiku که قراره در هفتههای آینده عرضه بشه، در بعضی معیارها با عملکرد Claude 3 Opus، که زمانی پیشرفتهترین مدل Anthropic بود، برابری میکنه و هزینه و “سرعت تقریبی” اون مثل Claude 3 Haiku خواهد بود.

Anthropic در یه پست نوشت: “با تأخیر کم، پیروی از دستورالعملهای بهبود یافته و استفاده دقیقتر از ابزار، Claude 3.5 Haiku برای محصولات مواجه با کاربر، وظایف زیرعامل تخصصی و تولید تجربههای شخصیسازی شده از حجم زیادی از دادهها – مثل سابقه خرید، قیمتگذاری یا دادههای موجودی – مناسبه.”

3.5 Haiku در ابتدا به عنوان یه مدل فقط متنی در دسترس خواهد بود و بعداً به عنوان بخشی از یه بسته چندرسانهای که میتونه هم متن و هم تصویر رو تحلیل کنه، عرضه میشه.

پس وقتی 3.5 Haiku در دسترس قرار گرفت، آیا دلیل زیادی برای استفاده از 3 Opus وجود خواهد داشت؟ درباره 3.5 Opus، جانشین 3 Opus، که Anthropic در ماه ژوئن به اون اشاره کرد چطور؟

سخنگوی Anthropic گفت: “همه مدلها در خانواده مدل Claude 3 کاربردهای خاص خودشون رو برای مشتریان دارن. Claude 3.5 Opus در نقشه راه ما قرار داره و به محض اینکه بتونیم، حتماً اطلاعات بیشتری رو به اشتراک میذاریم.”

پاسخی بگذارید